Au siècle dernier on trouvait dans tous les appareils photo des pellicules. Une pellicule est une surface photosensible (surface qui réagit à la lumière) qui capte les informations lumineuses. Une fois la pellicule terminée (avec une pellicule on peut faire un nombre variable de photos : 6, 12, 24 ou 36), elle était extraite de l'appareil photo puis développée dans un laboratoire spécialisé grâce à des procédés chimiques, bref, tout cela était quelque peu complexe et quelque peu contraignant (par exemple une photo ratée, était tout de même développée et donc facturée...). Aujourd'hui, finies ces contraintes, on peut prendre autant de photos que l'on veut (dans la limite des capacités mémoires de l'appareil), effacer une photo si elle ne nous convient pas, imprimer uniquement certaines photos sur l'imprimante familiale. Cela a été rendu possible grâce au progrès de l'informatique et de l'électronique et plus particulièrement grâce à l'arrivée dans l'électronique grand public des capteurs photo.

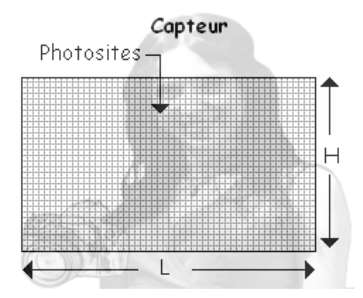

Le capteur photo remplace la pellicule, un capteur photo est donc une surface photosensible. Le capteur photo est composé d'un grand nombre de photosites, chaque photosite est constitué d'une photodiode à base de silicium, capable d'absorber les photons d'énergie supérieure à 1,14 eV.

Par effet photoélectrique, ces photons absorbés sont à l'origine d'un signal électrique proportionnel à la quantité de lumière reçue. Ce signal analogique est ensuite numérisé grâce à un convertisseur analogique numérique puis traité avant d'être stocké en mémoire. Plus l'intensité lumineuse reçue par le photosite est importante plus le photosite produira une tension électrique importante.

La tension électrique produite par un photosite sera ensuite "convertie" en nombre (on parle de numérisation), à chaque photosite on associera donc un nombre qui sera fonction de la quantité de lumière reçue par ce même photosite. C'est ces nombres qui seront "stockés" dans la mémoire de l'appareil photo.

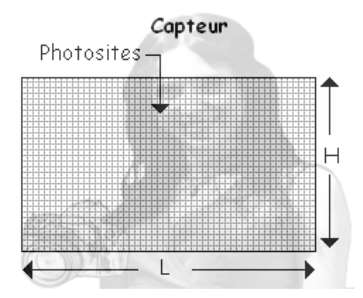

Si l'on se contentait de ce système, nous aurions uniquement des images en niveau de gris (souvent appelé à tort image en "noir et blanc"). Afin de pouvoir gérer les couleurs, on rajoute donc un filtre coloré devant chaque photosite. Nous avons vu, dans la partie consacrée aux images, qu'il est possible de générer un grand nombre de couleurs uniquement à partir du rouge, du vert et du bleu, nous allons donc trouver 3 types de filtres : des filtres "rouges" (qui laisseront uniquement passer la lumière rouge), des filtres "verts" (qui laisseront uniquement passer la lumière verte) et des filtres "bleus" (qui laisseront uniquement passer la lumière bleue). À chaque photosite on associera soit un filtre rouge, soit un filtre vert, soit un filtre bleu. Il existe différentes façons d'agencer les filtres sur le capteur photo, mais nous ne rentrerons pas dans ces détails ici.

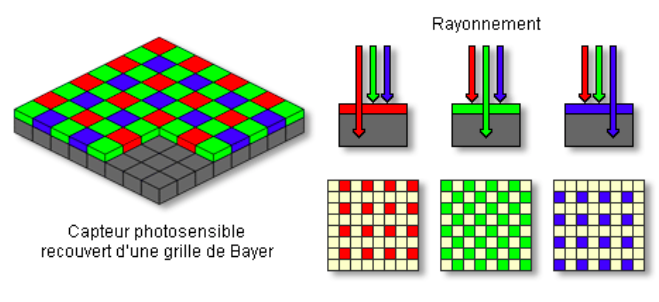

Comme vous pouvez le constater sur l'image ci-dessus, les filtres dits "Bayer" sont constitués de 50% de filtres vert, de 25% de filtre rouge et de 25% de filtre bleu afin d'imiter la physiologie de l'oeil humain (notre oeil est plus sensible au vert qu'au bleu et au rouge).

Précédemment nous avons vu qu'une image est constituée de pixels, mais dans le cas d'une photo d'où vient l'information (canal rouge, canal vert et canal bleu) associée à chaque pixel de la photo ?

La réponse est simple : des photosites du capteur photo. L'association de 4 photosites (deux verts, un rouge et un bleu) donnera les informations qui permettront de créer un pixel de l'image.

La résolution du capteur caractérise la taille de l'image exprimée en millions de pixels. Plus un capteur possède de photosites, plus sa résolution est importante.

Chaque photosite est associé à l'une des 3 couleurs élémentaires (rouge, vert, bleu) d'un point (pixel) de l'image.

Les techniques utilisées, pour générer des pixels à partir des photosites, varient plus ou moins selon les fabriquants. En général chaque pixel est calculé par interpolation de plusieurs photosites.

Par exemple :

Sur le regroupement de 4 photosite sur la figure précédente, la valeur de codage correspondant au vert est obtenue par la moyenne des 2 photosites verts voisins ; la couleur ainsi récupérée pour le pixel s'approche du fuchsia.

Le fait que chaque pixel est calculé par interpolation de plusieurs photosites n'implique pas obligatoirement l'existence d'un plus grand nombre de photosites que de pixels, car un même photosite peut être utilisé plusieurs fois lors des calculs.

Par exemple, avec la technique basée sur l'utilisation d'un "filtre de Bayer", chaque pixel est reconstitué à l'aide d'un calcul d'interpolation d'un photosite rouge, d'un photosite bleu et de deux photosites verts (la prise en compte de deux photosites vert permet de tenir compte de la sensibilité particulière de l'oeil à cette couleur : en effet la rétine est tapissées de cellules sensibles aux radiations colorées, les cônes. Il en existe 3 types chacun sensibles aux radiations rouge, verte et bleue dont les proportions sont les suivantes : il y a environ 40 verts pour 20 rouges et pour un bleu. L’œil est donc plus sensible au vert qu’aux autres couleurs primaires).

Dans ce cas les fabriquants considèrent qu'il y a autant de pixels que de photosites, étant donné que chaque pixel est le résultat de l'interpolation de la valeur de chaque photosite et de trois photosites voisins ( en négligeant le nombre de photosites situés sur les bords du capteur).

Le schéma illustre la correspondance photosites-pixels et montre qu'il y a autant de pixels que de photosites bien qu'un pixel quelconque soit calculé à partir de 4 photosites. En effet, un même photosite peut être utilisé pour le calcul de 4 pixels différents...

L'image est discrétisée.

L'image est discrétisée.

L'image est convertie en un tableau de chiffres.

L'image est convertie en un tableau de chiffres.